Kimi K2 Thinking 是 Moonshot AI 开发的一款经过推理优化的大型语言模型,旨在提升多步骤问题解决、规划和结构化输出能力。本指南将解释 Kimi K2 Thinking 的基本概念,介绍如何通过 Ollama 和 Unsloth 在本地运行它,如何有效地提示它,以及如何在 Ima Studio 的 Arena 中将其与其他推理模型进行对比评估。我们始终遵循 Google EEAT 原则:引用原始资料,明确区分已知信息和未经证实的信息,并提供可复现的步骤和评估思路。.

Kimi K2 在想什么?

Kimi K2 Thinking 是 Moonshot AI K2 系列的一部分,其变体专为“思考”任务而设计,例如结构化推理、多跳问答和约束条件下的分析。该模型可在社区工具和开放模型中心获取,Moonshot AI 和开源生态系统均提供相关文档和快速入门指南。.

- 模型卡片和文物: 拥抱脸:moonshotai/Kimi-K2-思考

- 官方文档概览: Moonshot AI K2 思考文档

- 本地加速指南: Unsloth:如何运行 Kimi K2 本地化思考

- 羊驼模型: Ollama:kimi-k2-thinking

许可协议、上下文长度和参数数量可能因版本和量化级别而异。使用前务必确认模型卡上的许可协议和技术规格,尤其是在商业部署中。.

Run Kimi K2 本地化思考

在您的机器上运行 Kimi K2 Thinking 有多种社区支持的方法。您的选择取决于您的硬件、首选框架以及是否需要 GPU 加速。.

选项 A:奥拉玛(起步最快)

- 请从官方网站安装 Ollama。.

- 拉出模型:

ollama 拉 kimi-k2-thinking - 跑步:

ollama 跑 kimi-k2-thinking

备注:检查 奥拉玛图书馆页面 精确的模型名称标签和可用的量化值。.

选项 B:Unsloth(GPU 加速的 Transformers)

- 跟随 Unsloth 的指南 用于环境设置。.

- 最小 Python 示例:

from transformers import AutoTokenizer, AutoModelForCausalLM import torch model_id = "moonshotai/Kimi-K2-Thinking" tokenizer = AutoTokenizer.from_pretrained(model_id, trust_remote_code=True) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.float16, device_map="auto", trust_remote_code=True ) prompt = "总结使用推理优化的 LLM 进行金融分析的关键权衡。." inputs = tokenizer(prompt, return_tensors="pt").to(model.device) outputs = model.generate(**inputs, max_new_tokens=300, temperature=0.3) print(tokenizer.decode(outputs[0], skip_special_tokens=True))

注意:内存需求取决于模型大小和量化级别。如果内存受限,请使用 4 位/8 位加载,或使用具有足够显存的消费级 GPU。有关性能调优,请参阅 Unsloth 文档。.

选项 C:拥抱脸变形金刚(原版)

使用与上述相同的模式,但不要使用 Unsloth 特有的加速度。检查 模型卡 Moonshot AI 推荐的分词器和生成参数。.

合规性提醒:在将模型集成到生产工作流程之前,务必查看模型的许可和预期用途。.

促使 Kimi K2 进行有效思考

“思考”模型通常对范围明确的任务和结构化的输出反应最佳。.

- 首先明确目标和限制条件:受众、时长、格式以及要避免的事项。.

- 提供相关的背景信息或例子,而不是让它猜测。.

- 要求提供结构化的答案(要点式、JSON 或编号计划),而不是自由形式的散文。.

- 仅在必要时要求提供简洁的理由(例如,“简要说明您的选择理由”),以减少冗长和延迟。.

- 设置确定性解码进行评估(温度 0–0.3,top_p 0.9),并提高复杂任务的限制(max_new_tokens)。.

模板:结构化规划

任务:制定一个五步计划,使用真实用户任务评估{产品/服务}。背景:我们关注准确性、延迟和成本。目标用户是{角色}。限制条件:- 提供编号步骤 - 注明所需指标和简单的评分标准 - 理由说明控制在80字以内 输出格式:1) 步骤 2) 指标和评分标准 3) 风险及缓解措施模板:数据转文本分析

目标:向非技术利益相关者解释以下数据集中的关键趋势。数据集摘要:{粘贴概要统计数据或几行数据} 要求:- 两句话的摘要 - 三个要点(每个不超过 20 字) - 一个需要向数据团队提出的后续问题使用可重复的方法评估 Kimi K2 思维

近期媒体报道对Kimi K2 Thinking的性能做出了大胆的宣传,甚至将其与GPT-5相提并论。截至撰写本文时,这些说法尚未在同行评审的文献中得到独立验证。为了获得可靠的评估结果,建议采用透明的基准测试和您自己的任务评估方法。.

- 公开基准测试:MMLU(综合知识)、GSM8K(数学)、HumanEval/MBPP(编码)、BBH(推理)。请使用一致的解码设置。.

- 类似生产环境的任务:文档、样式指南、特殊情况处理。跟踪准确率、延迟和成本。.

- 盲测比较:相同的提示,匿名化的输出,人工评分。.

- 工具增强型任务:如果您的工作流程使用检索或函数调用,请将这些操作包含在测试中。.

权威的评估实践资源包括学术基准和项目,例如斯坦福大学的HELM项目以及更广泛的LLM评估文献。务必记录提示、设置和版本,以确保结果可复现。.

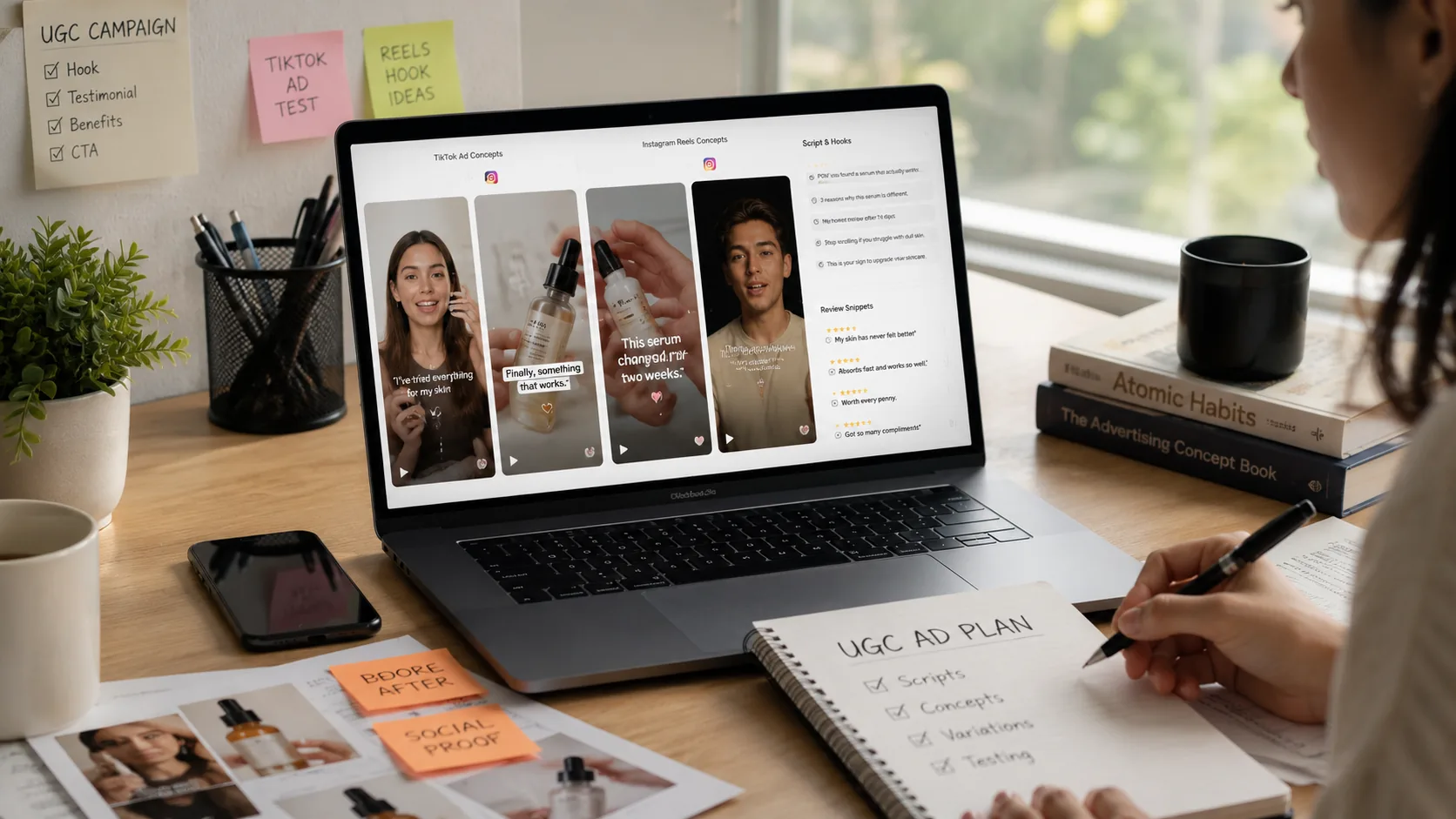

Ima Studio Arena 的并排测试

Ima Studio 集成了主流的生成模型,并能自动选择适合您任务的模型。 Ima Arena, 您可以使用相同的提示将 Kimi K2 Thinking 与其他推理模型进行比较,并投票选出最佳输出。.

- 打开 Ima Arena.

- 粘贴推理提示(计划、多步骤质量保证或代码解释)。.

- 选择对比型号(例如 DeepSeek-R1、Llama 3.1 70B Instruct、Qwen2.5 72B、o3-mini 或其他可用选项)。.

- 生成输出结果并进行匿名评审。请根据质量、忠实度和清晰度进行投票。.

- 如果您跳过手动选择,Ima 可以根据您的意图默认路由到合适的模型。.

提示:将效果最佳的提示信息保存为可重复使用的模板。 Ima Studio 社区 这样您的团队就可以一键重复使用它们。.

哪里可以买到 Kimi K2 Thinking 以及如何运行它

| 来源 | 你将获得什么 | 笔记 |

|---|---|---|

| 拥抱脸 | 型号卡、重量/检查点、使用说明 | 确认许可证、上下文长度和量化值 |

| 登月计划文档 | 概述和推荐设置 | 请遵循官方指南进行发电参数设置 |

| Unsloth | 本地 GPU 加速指南 | 有利于提高速度/显存效率 |

| 奥拉玛 | 单命令本地运行时 | 使用提供的模型标签;检查量化选项 |

面向创作者和团队的使用案例

- 研究与分析:结构化简报、比较矩阵和风险评估。.

- 产品和运营:标准操作规程制定、测试计划设计、事件事后分析及简明理由。.

- 内容工作流程:大纲、分类法和具有严格样式约束的编辑日历。.

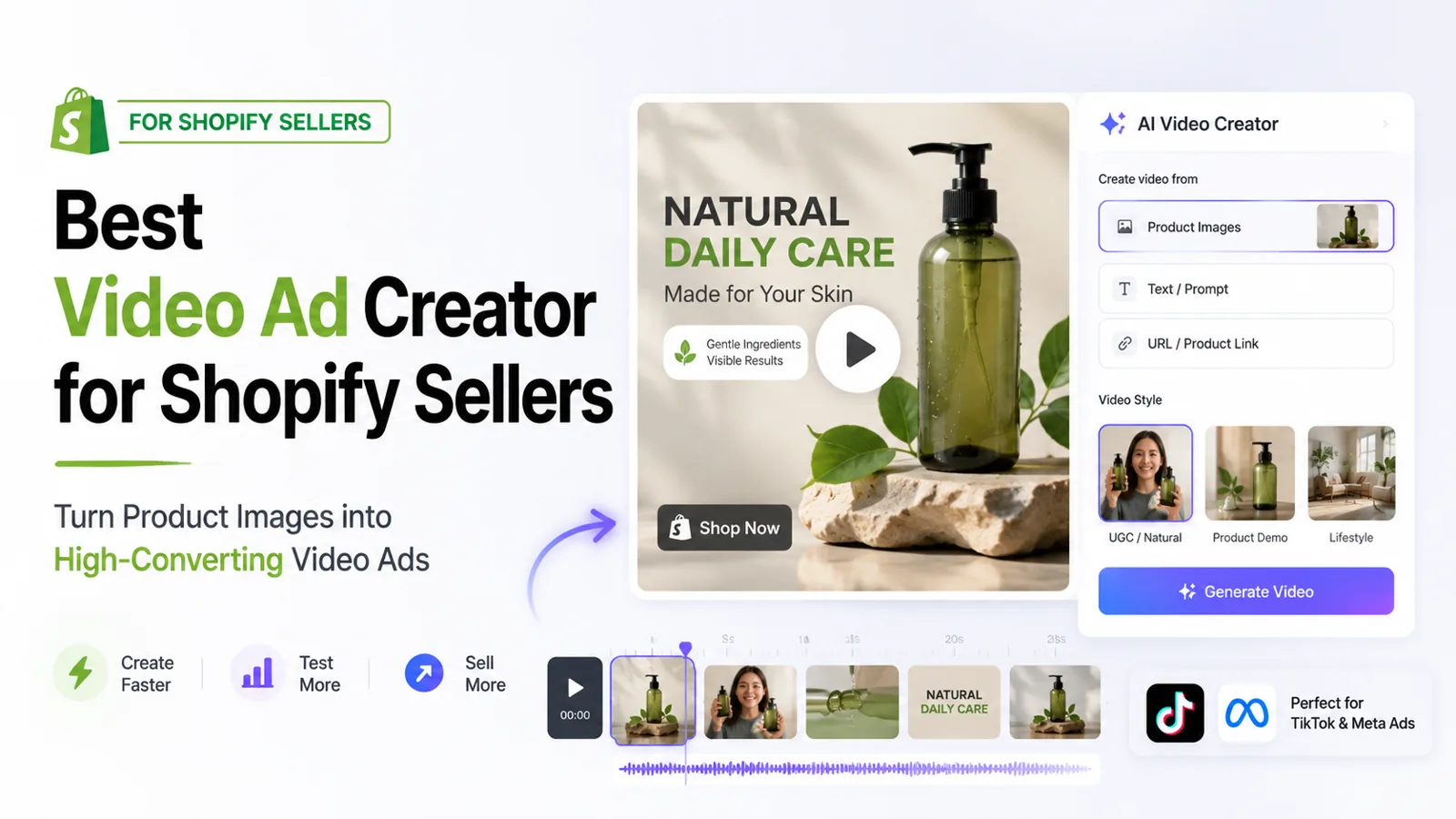

- 视觉+文本推理:解释图像、提取结构化属性或规划编辑;试试看 用照片聊天.

- 智能体自动化:构建一个无需编写代码的智能体,该智能体能够为每个步骤选择最佳模型;参见 如何创建人工智能代理.

确保输出可靠性的最佳实践

- 结合上下文:提供相关的片段或数据,而不是通用的提示。.

- 限制输出:指定标记、部分和允许的格式,以减少偏差。.

- 持续评估:跟踪不同版本和提示的准确性/一致性。.

- 防护措施:避免请求敏感数据;使用 Ima Arena 中的辅助检查或替代模型验证关键输出。.

常见问题

Kimi K2 Thinking 能“击败 GPT-5”吗?

一些媒体文章声称 Kimi K2 Thinking 可以与顶尖的商业模型相媲美,并提出了强有力的论断。但这些论断并未经过同行评审的独立验证。在进行决策时,请依据您自身的任务评估和上述透明的基准进行判断。Kimi K2 Thinking 是开源的吗?

可用性和许可详情已记录在案。 拥抱脸模型卡. 请查阅许可协议,以确定商业用途、再分发权和署名要求。我可以将 Kimi K2 Thinking 集成到 Ima Studio 中吗?

Ima Studio 整合了主流模型,并能将任务路由到最佳可用模型。如果您拥有 API 或权重访问权限,即可将其连接到您的工作流程并进行测试。 Ima Arena. 否则,可以直接在 Arena 中比较可用的推理模型。.

相关 Ima Studio 资源

参考文献及延伸阅读

- 拥抱脸:Kimi K2 思考模型卡

- Moonshot AI:K2思维文档

- Unsloth:运行 Kimi K2 本地思考

- Ollama:kimi-k2-thinking

- 关于评估实践:学术基准测试,例如 MMLU、GSM8K、HumanEval、BBH;以及调查项目,例如斯坦福 HELM。

结论

Kimi K2 Thinking 是一款很有前途的、以推理为中心的学习模型,您可以通过 Ollama 或 Unsloth 在本地运行它,并使用您自己的任务对其进行严格评估。为了做出基于证据的决策,您可以将其与其他模型并排比较。 Ima Studio Arena, 保存获胜提示 伊玛社区, 并将表现最佳的代理整合到您的代理工作流程中。这种方法可确保您在准确性、延迟和成本方面获得可衡量的提升,而无需依赖未经核实的索赔。.