Kimi K2 Thinking es un modelo de lenguaje grande optimizado para el razonamiento, desarrollado por Moonshot AI. Está diseñado para mejorar la resolución de problemas en múltiples pasos, la planificación y la generación de resultados estructurados. En esta guía, explicamos qué es Kimi K2 Thinking, cómo ejecutarlo localmente mediante Ollama y Unsloth, cómo utilizarlo eficazmente y cómo evaluarlo comparándolo con otros modelos de razonamiento en Arena de Ima Studio. A lo largo de la guía, seguimos los principios de Google EEAT: citamos fuentes primarias, aclaramos qué se sabe y qué no se ha verificado, y proporcionamos pasos reproducibles e ideas para la evaluación.

¿En qué está pensando Kimi K2?

Kimi K2 Thinking forma parte de la serie K2 de Moonshot AI, con una variante optimizada para tareas de "pensamiento", como el razonamiento estructurado, la respuesta a preguntas de múltiples pasos y el análisis con restricciones. El modelo está disponible en herramientas comunitarias y centros de modelos abiertos, con documentación y guías de inicio rápido proporcionadas tanto por Moonshot AI como por el ecosistema de código abierto.

- Tarjeta modelo y artefactos: Cara de abrazo: moonshotai/Kimi-K2-Thinking

- Resumen de la documentación oficial: Moonshot AI K2 Thinking docs

- Guía de aceleración local: Unsloth: Cómo gestionar Kimi K2 Pensando localmente

- Modelo Ollama: Ollama: kimi-k2-pensamiento

Las licencias, la duración del contexto y el número de parámetros pueden variar según la versión y la cuantización. Confirme siempre la licencia y las especificaciones técnicas de la tarjeta del modelo antes de usarla, especialmente en implementaciones comerciales.

Run Kimi K2 Pensando localmente

Existen varias formas, respaldadas por la comunidad, de ejecutar Kimi K2 Thinking en tu ordenador. La elección dependerá de tu hardware, el entorno de desarrollo que prefieras y si necesitas aceleración por GPU.

Opción A: Ollama (arranque más rápido)

- Instala Ollama desde el sitio web oficial.

- Extraer el modelo:

ollama tira kimi-k2-pensamiento - Correr:

ollama corre kimi-k2-pensando

Notas: Compruebe el Página de la biblioteca de Ollama para obtener etiquetas de nombre de modelo exactas y cuantizaciones disponibles.

Opción B: Unsloth (Transformers acelerados por GPU)

- Seguir Guía de Unsloth para la configuración del entorno.

- Ejemplo mínimo de Python:

from transformers import AutoTokenizer, AutoModelForCausalLM import torch model_id = "moonshotai/Kimi-K2-Thinking" tokenizer = AutoTokenizer.from_pretrained(model_id, trust_remote_code=True) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.float16, device_map="auto", trust_remote_code=True ) prompt = "Resume las principales ventajas y desventajas de usar un LLM optimizado para el razonamiento en el análisis financiero." inputs = tokenizer(prompt, return_tensors="pt").to(model.device) outputs = model.generate(**inputs, max_new_tokens=300, temperature=0.3) print(tokenizer.decode(outputs[0], skip_special_tokens=True))

Notas: Los requisitos de memoria dependen del tamaño del modelo y la cuantización. Si la memoria es limitada, utilice la carga de 4 o 8 bits, o una GPU de consumo con suficiente VRAM. Consulte la documentación de Unsloth para optimizar el rendimiento.

Opción C: Transformers con caras abrazables (vainilla)

Utilice el mismo patrón que el anterior sin aceleraciones específicas de Unsloth. Revise el tarjeta modelo para los parámetros de tokenización y generación recomendados por Moonshot AI.

Recordatorio sobre el cumplimiento normativo: revise siempre la licencia del modelo y su uso previsto antes de integrarlo en los flujos de trabajo de producción.

Impulsando a Kimi K2 a pensar eficazmente

“Los modelos de "pensamiento" suelen responder mejor a tareas bien definidas y resultados estructurados.

- En primer lugar, indique el objetivo exacto y las limitaciones: público objetivo, duración, formato y qué se debe evitar.

- Proporcione contexto o ejemplos relevantes en lugar de pedirle que adivine.

- Solicita una respuesta estructurada (con viñetas, en formato JSON o un plan numerado) en lugar de una respuesta en prosa libre.

- Solicite justificaciones concisas solo cuando sea necesario (por ejemplo, "justifique brevemente su elección") para reducir la verbosidad y la demora.

- Establezca la decodificación determinista para la evaluación (temperatura 0–0,3, top_p 0,9) y límites más altos para tareas complejas (max_new_tokens).

Plantilla: Planificación estructurada

Tarea: Elaborar un plan de 5 pasos para evaluar {producto/servicio} utilizando tareas de usuarios reales. Contexto: Nos interesan la precisión, la latencia y el coste. Los usuarios objetivo son {rol}. Restricciones: - Proporcionar pasos numerados - Indicar las métricas requeridas y una rúbrica de puntuación sencilla - Mantener la justificación en un máximo de 80 palabras Formato de salida: 1) Pasos 2) Métricas y rúbrica 3) Riesgos y medidas de mitigaciónPlantilla: Análisis de datos a texto

Objetivo: Explicar las tendencias clave del conjunto de datos a continuación a una persona sin conocimientos técnicos. Resumen del conjunto de datos: {pegar estadísticas generales o algunas filas} Requisitos: - Resumen de dos frases - Tres puntos clave (cada uno de menos de 20 palabras) - Una pregunta de seguimiento para el equipo de datosEvaluar el pensamiento de Kimi K2 con métodos reproducibles.

Los titulares recientes de los medios de comunicación sugieren afirmaciones audaces sobre el rendimiento de Kimi K2 Thinking, incluyendo comparaciones con GPT-5. Dichas afirmaciones no han sido verificadas de forma independiente en publicaciones revisadas por pares hasta la fecha. Para evaluaciones fiables, se recomienda utilizar puntos de referencia transparentes y realizar sus propias evaluaciones de tareas.

- Pruebas de referencia públicas: MMLU (conocimiento general), GSM8K (matemáticas), HumanEval/MBPP (código), BBH (razonamiento). Utilice una configuración de decodificación consistente.

- Tareas propias de un entorno de producción: tu documentación, tus guías de estilo, tus casos excepcionales. Controla la precisión, la latencia y el coste.

- Comparaciones a ciegas: misma consigna, resultados anonimizados, evaluadores humanos.

- Tareas que requieren herramientas adicionales: si su flujo de trabajo utiliza la recuperación de datos o la llamada a funciones, inclúyalas en la prueba.

Entre los recursos autorizados para las prácticas de evaluación se incluyen referencias académicas y proyectos como el HELM de Stanford, así como la bibliografía general sobre la evaluación de programas de maestría en derecho (LLM). Documente siempre las indicaciones, la configuración y las versiones para garantizar la reproducibilidad.

Pruebas en paralelo en el Ima Studio Arena.

Ima Studio integra modelos generativos convencionales y puede redirigir automáticamente a un modelo adecuado para su tarea. Con Arena Ima, Puedes comparar Kimi K2 Thinking con otros modelos de razonamiento utilizando la misma pregunta y votar por el mejor resultado.

- Abierto Arena Ima.

- Pegue una pregunta que explique el razonamiento (planificación, control de calidad en varios pasos o explicación del código).

- Seleccione modelos de comparador (por ejemplo, DeepSeek-R1, Llama 3.1 70B Instruct, Qwen2.5 72B, o3-mini u otras opciones disponibles).

- Genera resultados y revísalos a ciegas. Vota por la calidad, la fidelidad y la claridad.

- Si omites la selección manual, Ima puede redirigirte al modelo adecuado por defecto en función de tu intención.

Consejo: Guarda tus indicaciones con mejor rendimiento como plantillas reutilizables en el Comunidad de Ima Studio para que tu equipo pueda reutilizarlos con un solo clic.

Dónde conseguir Kimi K2 Thinking y cómo usarlo

| Fuente | Lo que obtienes | Notas |

|---|---|---|

| Cara de abrazo | Ficha del modelo, pesos/puntos de control, notas de uso | Confirmar licencia, duración del contexto y cuantizaciones |

| Documentos de Moonshot | Descripción general y configuración recomendada | Siga las directrices oficiales para los parámetros de generación. |

| Sin pereza | Guía de aceleración de GPU local | Bueno para la velocidad/eficiencia de la VRAM |

| Ollama | Entorno de ejecución local con un solo comando | Utilice la etiqueta de modelo proporcionada; compruebe las opciones de cuantización. |

Casos de uso para creadores y equipos

- Investigación y análisis: informes estructurados, matrices comparativas y evaluación de riesgos.

- Producto y operaciones: Generación de procedimientos operativos estándar (SOP), diseño de planes de prueba, análisis post mortem de incidentes con justificaciones concisas.

- Flujos de trabajo de contenido: esquemas, taxonomías y calendarios editoriales con estrictas restricciones de estilo.

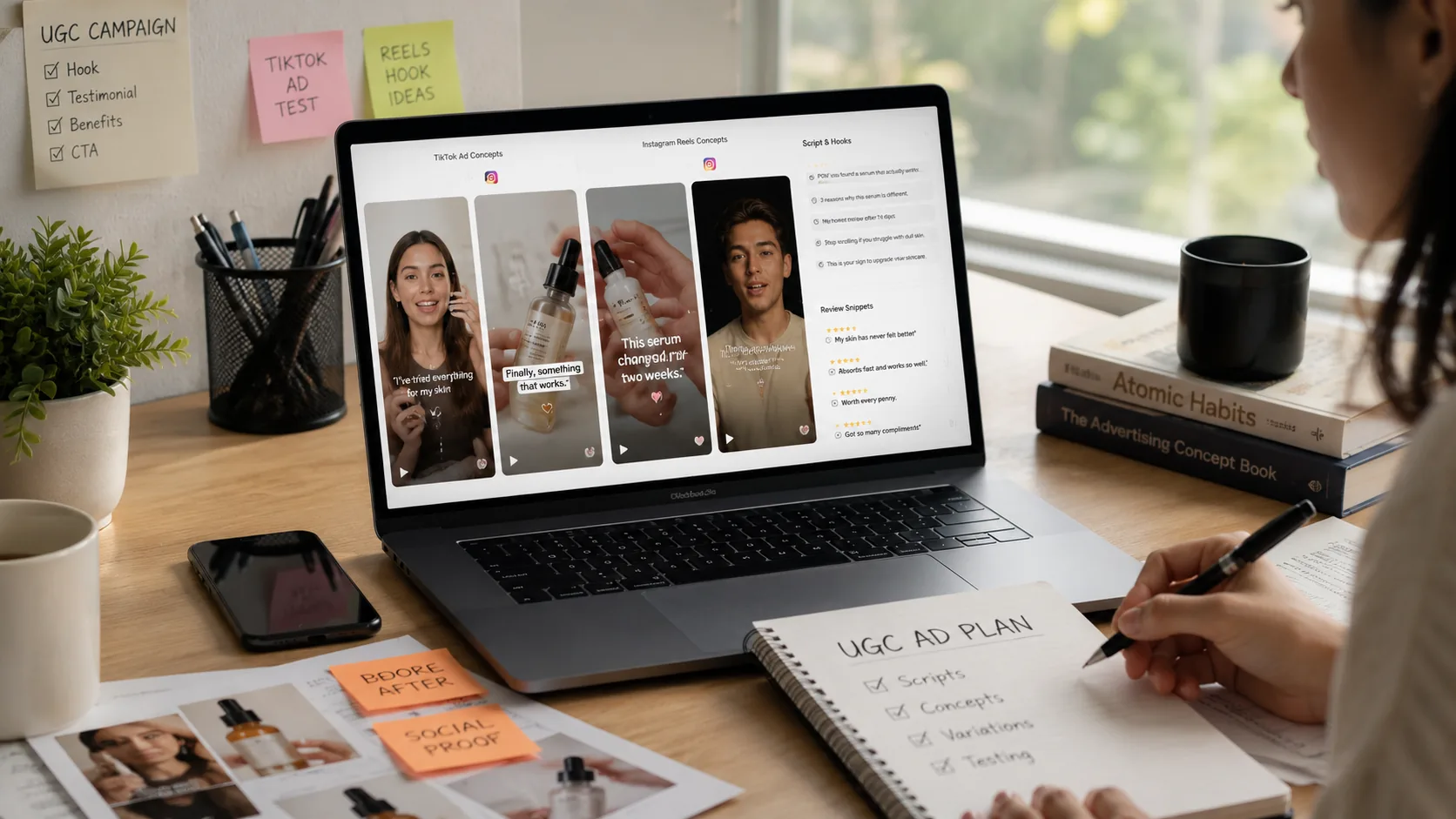

- Visión + razonamiento textual: explicar una imagen, extraer atributos estructurados o planificar ediciones; inténtelo. Chatea con Foto.

- Automatizaciones basadas en agentes: cree un agente sin código que dirija al mejor modelo para cada paso; consulte Cómo crear un agente de IA.

Buenas prácticas para obtener resultados fiables

- Contextualización: proporcione fragmentos o datos relevantes en lugar de indicaciones genéricas.

- Limitar las salidas: especificar tokens, secciones y formatos permitidos para reducir la desviación.

- Evaluar continuamente: realizar un seguimiento de la precisión y la coherencia entre las distintas versiones y las indicaciones.

- Medidas de seguridad: evite solicitar datos confidenciales; valide los resultados críticos mediante comprobaciones secundarias o modelos alternativos en Ima Arena.

Preguntas frecuentes

¿Kimi K2 Thinking "supera a GPT-5"?

Algunos artículos de prensa presentan afirmaciones contundentes que comparan Kimi K2 Thinking con modelos propietarios de primer nivel. Estas afirmaciones no han sido verificadas de forma independiente mediante revisiones por pares. Para tomar decisiones, confíe en sus propias evaluaciones de tareas y en los parámetros de referencia transparentes descritos anteriormente. ¿Es Kimi K2 Thinking de código abierto?

La disponibilidad y los detalles de la licencia están documentados en el Tarjeta modelo de Hugging Face. Revise la licencia para determinar el uso comercial, los derechos de redistribución y los requisitos de atribución. ¿Puedo integrar Kimi K2 Thinking en Ima Studio?

Ima Studio agrega modelos convencionales y puede dirigir las tareas al mejor modelo disponible. Si tiene acceso a la API o a los pesos, puede conectarlo a su flujo de trabajo y probarlo en Arena Ima. De lo contrario, compare los modelos de razonamiento disponibles directamente en Arena.

Recursos relacionados de Ima Studio

- Ima Arena: Análisis comparativo de modelos

- Comunidad Ima: Plantillas gratuitas para indicaciones y flujos de trabajo.

- Cómo crear un agente de IA (sin código, herramientas gratuitas)

- El mejor generador de vídeo con IA de 2025: Pruebas reales en Ima Studio

Referencias y lecturas adicionales

- Cara de abrazo: Tarjeta modelo de pensamiento de Kimi K2

- Inteligencia Artificial de Alto Impacto: Documentación de K2 Thinking

- Unsloth: Corre Kimi K2 Pensando localmente

- Ollama: kimi-k2-pensamiento

- Sobre la práctica de la evaluación: puntos de referencia académicos como MMLU, GSM8K, HumanEval, BBH; proyectos de encuestas como Stanford HELM.

Conclusión

Kimi K2 Thinking es un LLM prometedor centrado en el razonamiento que puede ejecutar localmente a través de Ollama o Unsloth y evaluar rigurosamente con sus propias tareas. Para tomar decisiones basadas en evidencia, compárelo lado a lado con otros modelos en Ima Studio Arena, guarda las indicaciones ganadoras en el Comunidad Ima, e integra al mejor agente en sus flujos de trabajo. Este enfoque garantiza mejoras cuantificables en precisión, latencia y costes, sin depender de afirmaciones no verificadas.