AIビデオジェネレータを初めて試したとき、私は ポンプ.

私は映画のような響きの言葉を入力しました。「夜の未来都市を歩く男性」。

数分後、私は傑作を手に入れました。

ただし…それは熱にうなされて夢を見ているようでした。

男の顔は溶け、体は数フレームごとに歪み、光は消えゆくネオンサインのように明滅した。

最初に思ったことは?「うわー、AIビデオ技術はまだダメだ」

そして、私はRedditのスレッドに偶然出会った。 「AI が生成した動画はなぜあんなにひどいものなのでしょう?」

何百人もの人々が同じことについて不満を言っていました。

しかし、読み進めていくうちに、そして記事を掘り下げていくうちに、 デジタルブリュー, タグショップ、 そして HiggsfieldのSora 2プリセット — 私はこの分野全体に対する見方を変えるあることに気づきました。

AI動画が悪いのは、AIが愚かだからではありません。私たちがAIとどう話せばいいのか分からないからです。

AIはあなたを理解するのではなく、あなたを予測する

AI はあなたのビジョンを「見る」のではなく、あなたが何を意味するのかを推測します。

ほとんどの人は、あまりにも漠然としたプロンプトを入力します。

「夜の街を歩く男性」

人間にとっては問題ないかもしれませんが、AIモデルにとってはどうでしょうか?「都会的なものを描いてください」と言っているようなものです。

指示も、音色も、動作の合図もありません。

次にこれを試してください:

「ネオンライトの下を歩く男性の映画的なクローズアップ、背後からのカメラトラッキング、濡れた舗装の反射。」

突然、AI はカメラがどこにあるのか、どのような照明を使うべきか、動きがどのくらい速く感じられるかを知るようになります。

それは偶然ではありません。 タグショップ 通話 迅速な識字能力: 映画の撮影クルーに与えるのと同じ種類の指示を AI に与えることができる機能。

私たちのほとんどはまだそのスキルを持っていません。だからこそ、多くのAI動画は壊れた夢のように見えるのです。

AIビデオの品質が落ちてしまう理由

数週間にわたる実験(そして物事の破壊)を経て、私はこれらのシステムが実際にどのように機能するかを学びました。

ほとんどのAIビデオジェネレーター(例えば ソラ2、シーダンス、 または ヴィドゥ — は、2 つの主要コンポーネントに基づいて構築されています。

- 拡散モデル – 画像の品質と詳細を処理します。

- トランスフォーマー – 動きと時間の一貫性を処理します。

ハイテクな話ですよね?でも問題は「中間」にあります。

AIは実際には 理解する モーション — 最後のフレームに基づいて次のフレームを予測するだけです。

プロンプトが明確な空間的または時間的な手がかりを与えない場合、AI は推測を始めます。

そのとき、顔が歪んだり、光がちらついたり、物体が動いたりします。

として デジタルブリュー AI は意味を生み出すのではなく、ギャップを埋めるのです。

悪いフレームはすべて、あなたとモデルの間の誤解です。

より良いAI動画を作成するための2つの方法:プロンプトをマスターするか、プリセットを使用するか

これに気づいてから、私は2つの進むべき道が見えてきました。

- プロンプトの技術を習得するために数週間を費やします。

- 他の人のすでに完璧なものを使用してください。

私は2番目を選択しました。

正直に言うと、これは私が今年行った最も賢明なクリエイティブな決断でした。

次のようなプラットフォーム ヒッグスフィールド 方法を示す Sora 2のビデオプリセット すでに映画的な構成、照明ロジック、カメラのリズムが組み込まれています。

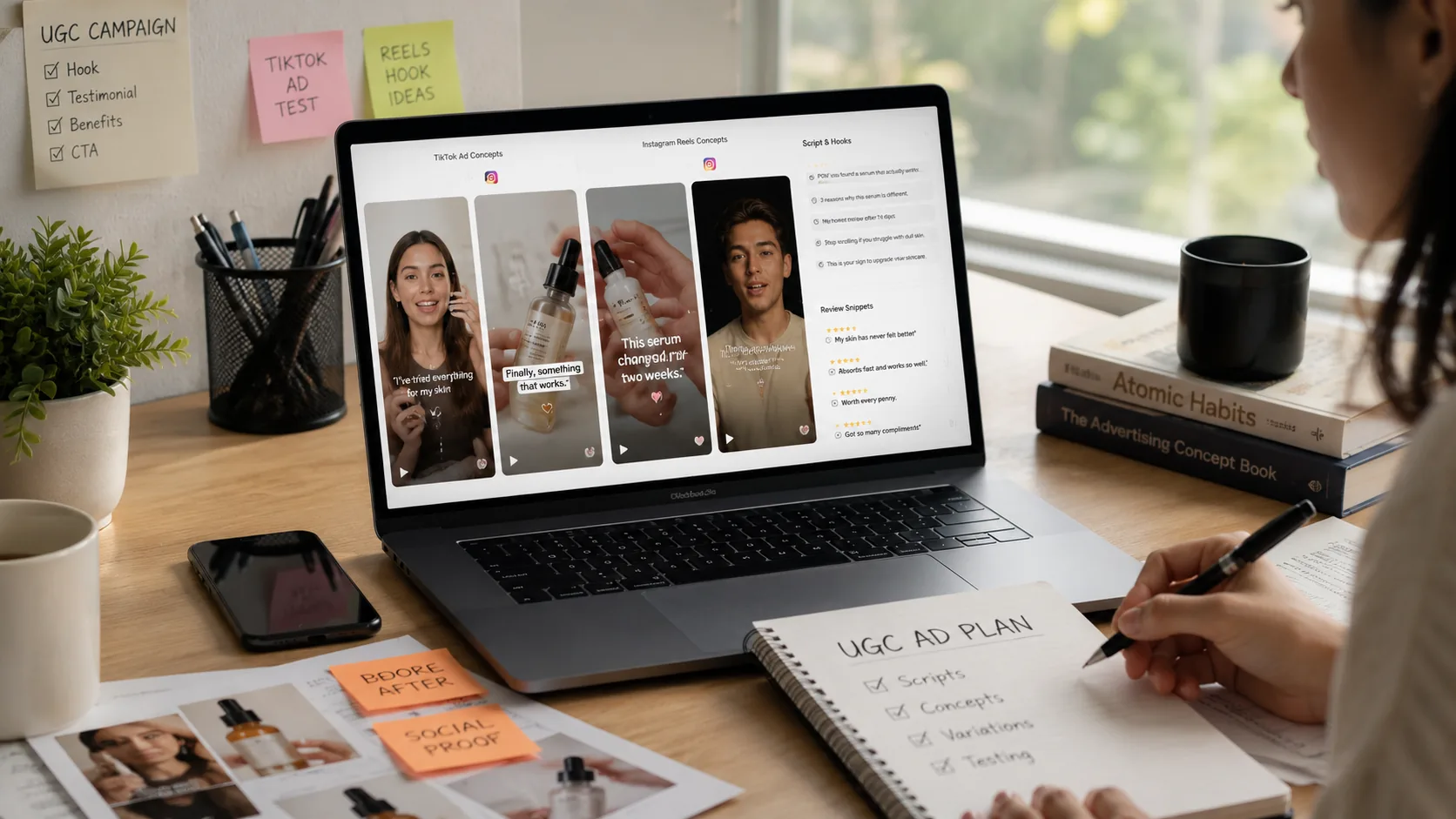

プロンプトに慣れていないならテンプレートを使う

真実はこうです。ほとんどの人は、見た目が良いものを早く作りたいだけなのです。

それで私は IMA Studioコミュニティ.

クリエイターが作った作品が満載 ビデオテンプレート, AIビデオプリセット、 そして TikTok風テンプレート すでに話題になっているもの。

「ホット」セクションからの私のお気に入り:

- 🎬 映画のような旅物語 – 都市や冒険のクリップに最適です。

- 💫 夢のような肖像画 – 柔らかい照明とポートレートスタイルのストーリーテリング。

- 💃 ダンスループ – 完璧なループモーションを備えたTikTokトレンド向けに設計されています。

これらのテンプレートが特別なのは、ただ美しいビジュアルだけではないということです。

彼らは 設計された AI向け。

それぞれに、フレーム間でモデルの一貫性を保つために調整されたプロンプト、カメラ ロジック、およびペーシングが含まれています。

被写体を入れ替え、いくつかの詳細を変更するだけで、意図が伝わるクリーンでダイナミックなビデオが完成します。

すぐに魔法をかける必要はありません。

Sora 2 + IMAテンプレート = 驚くほど良い結果

ある夜、私は「SFの夢の風景」のクリップを作りたいと思いました。

完全なプロンプトを書く代わりに、IMAコミュニティに行って SFシティナイト プリセット。

私がやったことは以下の通りです:

1️⃣ 自分のキャラクター画像をアップロードしました。

2️⃣ プロンプトタグ「女の子」を「宇宙飛行士」に変更しました。

3️⃣ 有効 スローモーション そして HDR より良い照明のために。

4️⃣ しましょう ソラ2 モーションシーケンスを処理します。

結果は非現実的でした。スムーズな動き、鮮明なディテール、完璧なネオンの反射です。

それを 4K でエクスポートして TikTok にアップロードしたところ、Unreal Engine で撮影されたのかと実際に聞かれました。

その時、それが分かりました。 制限となるのは AI ではなく、私たち自身です。

それを実現するには、適切なワークフローが必要です。

より賢いAIではなく、より賢い人間が重要だ

「AIの動画はどれも同じに見える」という声を聞くたびに、私はうなずきます。なぜなら、 する、全員が同じ怠惰なプロンプトを入力するとき。

しかし、強力なプリセット、厳選されたビデオ テンプレート、またはコミュニティでテストされた TikTok テンプレートを使い始めると、違いはすぐに現れます。

AIによる動画生成は創造性を置き換えるものではなく、 加速する それ。

本当の芸術性は、機械をどう誘導するかにあります。

技術的な面倒を避けて、プロ並みの成果をすぐに得たいなら、 IMA Studioコミュニティ.

そこでクリエイターたちは、AI がどのように「考える」かをすでに理解しているような、最も効果的なテンプレートを共有します。

プロンプトに関しては博士号は必要ありません。

まさに適切なプリセット、そしてアニメーション化する価値のあるビジョン。